Du hast bereits gesehen, wie Workflow-Automatisierung deine Apps verbinden und wiederkehrende, regelbasierte Aufgaben übernehmen kann. Aber was, wenn deine Automatisierungen mehr könnten als nur Anweisungen befolgen? Was, wenn sie Kontext verstehen, kreative Inhalte generieren, komplexe Informationen zusammenfassen und sogar Entscheidungen auf Basis unstrukturierter Daten treffen könnten? Genau hier entfaltet n8n AI seine wahre Stärke. Indem du Large Language Models (LLMs) direkt in deine Workflows integrierst, verwandelst du n8n von einem einfachen Task-Runner in eine intelligente Automatisierungs-Engine.

Die Kombination aus n8n und OpenAI oder anderen Modellen eröffnet dir eine völlig neue Welt an Möglichkeiten. Plötzlich kannst du KI-Automatisierungen bauen, die Daten nicht nur verarbeiten, sondern sie auch verstehen und anreichern. Dieser Guide richtet sich an alle, die bereit sind, den nächsten Schritt zu gehen. Wir zeigen dir, wie du jedes LLM mit n8n nutzen kannst – von der Erstellung eines einfachen Content-Generators bis hin zur Entwicklung komplexer KI-Agenten-Automatisierungen. Du lernst praxisnahe Skills, um Automatisierungen zu erstellen, die denken, analysieren und kreieren – alles innerhalb der flexiblen n8n-Umgebung.

Die Kraft der KI-Automatisierung mit n8n: Von einfachen Aufgaben zu komplexen Agenten

Im Kern liegt die Stärke von n8n AI in der Fähigkeit, über einfache, deterministische Logik hinauszugehen. Ein traditioneller Workflow arbeitet nach klaren Regeln: „Wenn eine neue E-Mail mit dem Betreff ‚Rechnung‘ eingeht, speichere den Anhang im Ordner ‚Rechnungen‘.“ Das ist vorhersehbar und effizient für strukturierte Aufgaben. Ein KI-Automatisierungs-Workflow hingegen basiert auf Verständnis und Intention: „Wenn eine neue E-Mail von einem Kunden eingeht, erkenne, ob es sich um eine Beschwerde, eine Frage oder ein Kompliment handelt, und leite sie an das passende Team weiter.“ Dies erfordert ein Maß an Verständnis, das nur KI bieten kann.

Was kannst du mit KI-Automatisierung erreichen?

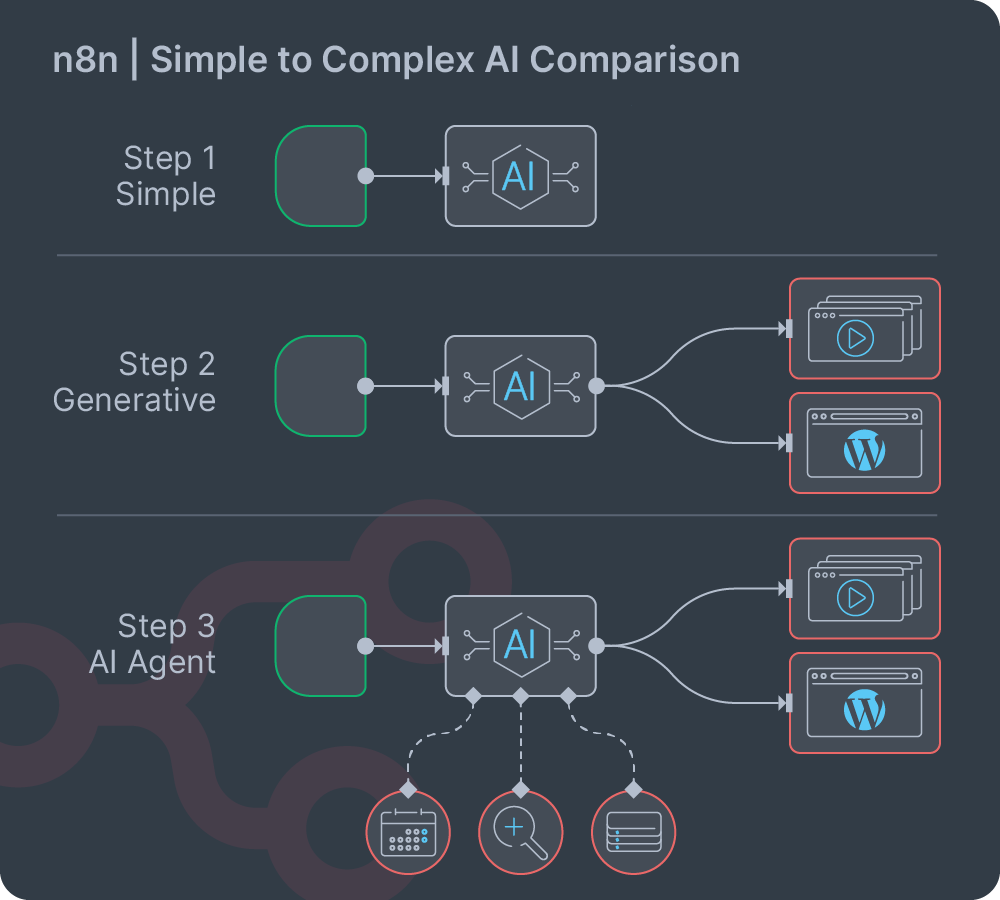

Diese Fähigkeit eröffnet dir ein breites Spektrum an Automatisierungsmöglichkeiten – von einfachen Erweiterungen bis hin zu vollständig autonomen Agenten:

- Einfache KI-Verbesserung: Das ist meist der Einstiegspunkt. Du kannst einen KI-Knoten zu einem bestehenden Workflow hinzufügen, um eine einzelne, spezifische Aufgabe zu übernehmen. Zum Beispiel könntest du nach dem Scraping einer Produktbewertung ein LLM einsetzen, um die Stimmung (positiv, negativ, neutral) sowie die genannten Hauptthemen zu erkennen.

- Generative Aufgaben: Anstatt nur Daten zu analysieren, können deine Workflows neue Inhalte erstellen. Du könntest zum Beispiel einen Workflow bauen, der einen Produktnamen und einige wichtige Merkmale als Eingabe erhält und daraus eine vollständige Marketingbeschreibung, einen Social-Media-Post und ein kurzes Videoskript generiert.

- Komplexes Denken mit Agenten: Das ist die fortschrittlichste Anwendung. Du kannst n8n-Agenten entwickeln – also Workflows, die mehrstufige Aufgaben mit einem gewissen Maß an Autonomie ausführen. Ein KI-Agent könnte zum Beispiel damit beauftragt werden, „eine Wochenendreise nach Paris für zwei Personen mit einem Budget von 500 $ zu planen“. Er müsste Flüge suchen, Hotels finden, Bewertungen prüfen und eine sinnvolle Reiseroute vorschlagen – ohne explizite Schritt-für-Schritt-Anweisungen. Dieses Verhalten markiert die nächste Entwicklungsstufe der KI-Automatisierung.

Durch die Integration von KI bist du nicht länger auf strukturierte Daten und vordefinierte Regeln deiner Anwendungen beschränkt. Du kannst auch mit der unstrukturierten, dynamischen Welt menschlicher Sprache und komplexer Dokumente arbeiten. Dies eröffnet dir ein völlig neues Niveau an Effizienz und Möglichkeiten.

Zentrale n8n-KI-Funktionen: RAG, Langzeitgedächtnis und Multi-Agenten-Systeme

Wenn du über einfache KI-Aufgaben hinausgehst, begegnest du fortgeschrittenen Konzepten, die das volle Potenzial intelligenter Automatisierung freisetzen. In n8n sind das keine 1-Klick-Lösungen, sondern leistungsstarke Systeme, die du durch das Kombinieren spezifischer Knoten aufbaust.

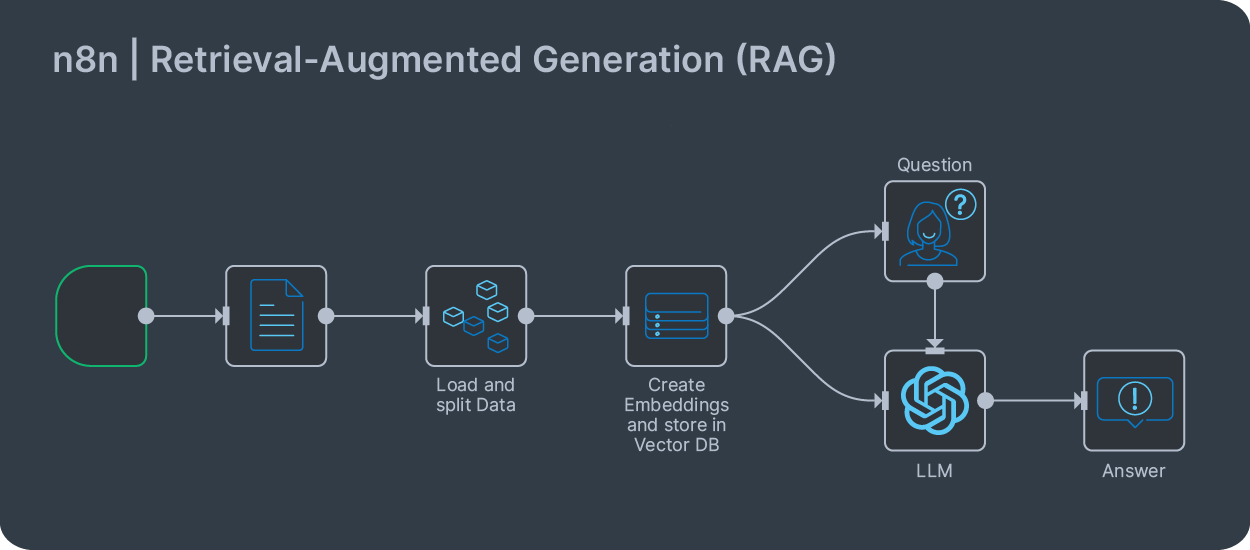

n8n Retrieval-Augmented Generation (RAG)

Ein Standard-LLM kann keine Fragen zu deinen privaten Unternehmensdaten beantworten. n8n Retrieval-Augmented Generation (RAG) löst das, indem es dem LLM Zugriff auf deine Informationen gibt. Du baust eine RAG-Pipeline, indem du mehrere Knoten miteinander verkettst:

- Daten laden: Du startest mit einem Document Loader-Knoten, wie „PDF4me“ oder „ScrapeNinja“, um dein Quellmaterial einzulesen.

- Daten aufteilen: Anschließend verbindest du einen „Split Out“ oder „Information Extractor“-Knoten, um den Text in kleinere, handhabbare Teile zu zerlegen.

- Embeddings erstellen und speichern: Diese Teile werden an einen Vektor-Store-Knoten wie „Pinecone“ weitergeleitet. Dieser Knoten wandelt die Teile in Vektoren um und fügt sie in deine Datenbank ein.

- Daten abfragen: Um eine Frage zu stellen, nutzt du einen Chain-Knoten, z. B. den „Question and Answer Chain“-Knoten. Dieser nimmt deine Anfrage entgegen, findet die relevantesten Teile im Vektor-Store und übergibt sowohl die Anfrage als auch die Teile an dein gewähltes LLM, um eine faktenbasierte Antwort zu generieren.

Intelligentere n8n-Agenten mit Langzeitgedächtnis erstellen

Damit eine KI echte Gespräche führen kann, braucht sie „Gedächtnis“. Du kannst zustandsbehaftete n8n-Agenten erstellen, die sich an frühere Interaktionen erinnern. Kurzzeitgedächtnis ist oft eingebaut, echtes Langzeitgedächtnis erreichst du jedoch, indem du Gesprächsverläufe in einer externen Datenbank speicherst.

So funktioniert es vereinfacht: Bevor du den „AI Agent“-Knoten aufrufst, nutzt du einen Datenbank-Knoten (wie „Airtable“ oder „Postgres“), um frühere Gesprächszusammenfassungen, die mit einer Benutzer-ID verknüpft sind, abzurufen. Dieses abgerufene „Gedächtnis“ injizierst du dann in den Prompt, den du an den Agenten sendest, sodass er den vollen Kontext hat, um eine kohärente, personalisierte Antwort zu geben.

Die Macht von Agenten und LangChain

Viele der leistungsstärksten KI-Funktionen von n8n basieren auf dem LangChain-Framework. LangChain ist ein Open-Source-Tool, das die Erstellung komplexer Anwendungen mit Sprachmodellen vereinfacht. Es bietet eine standardisierte Möglichkeit, Komponenten wie LLMs, Gedächtnis und Werkzeuge zu verketten, sodass sie zusammenarbeiten, um komplexe Probleme zu lösen.

Die n8n-LangChain-Integration bedeutet, dass du kein Python-Entwickler sein musst, um dieses mächtige Framework zu nutzen. n8n hat die Logik bereits in die visuelle Oberfläche integriert. Wenn du den „AI Agent“-Knoten nutzt, interagierst du mit einer benutzerfreundlichen Schicht, die auf den Grundprinzipien von LangChain aufbaut.

Somit kannst du leistungsstarke n8n-Agenten einfach durch das Verbinden von Knoten erstellen. Beispiel: Du kannst deinem KI-Agenten ein „Tool“ geben, indem du den „SerpApi„-Knoten damit verbindest. Wenn der Agent eine Anfrage bekommt, die er aus seinem Basiswissen nicht beantworten kann, kann er selbstständig entscheiden, das Suchwerkzeug zu nutzen, aktuelle Informationen zu finden und diese neuen Daten zu verwenden, um seine Antwort zu formulieren. Diese leistungsstarke Fähigkeit zum Schlussfolgern und Treffen von Entscheidungen ist der Kern dessen, was LangChain innerhalb von n8n ermöglicht.

KI-Modelle integrieren: n8n mit OpenAI, Gemini und anderen LLMs verbinden

Die Flexibilität von n8n ermöglicht es dir, dich mit praktisch jedem KI-Modell zu verbinden, das eine API hat. Egal, ob du ein großes kommerzielles Modell oder eine selbst gehostete Open-Source-Alternative nutzen willst – der Prozess ist unkompliziert.

Verbindung zu OpenAI herstellen

Der dedizierte n8n OpenAI-Knoten macht die Integration sehr simpel.

- Knoten hinzufügen: Füge in deinem Workflow den „OpenAI“-Knoten hinzu. Wähle in der Liste die Option „Message a model“.

- Anmeldedaten hinzufügen: Erstelle neue Anmeldedaten, indem du deinen OpenAI-API-Schlüssel angibst.

- Den Knoten konfigurieren:

- Ressource: Wähle „Text“ für konversationale Modelle.

- Modell: Wähle das spezifische Modell aus der Dropdown-Liste aus (z.B.

gpt-4-turbo,gpt-3.5-turbo). - Prompt: Gib den Prompt ein, den du an das Modell senden möchtest. Hier kannst du auch dynamische Daten aus vorherigen Knoten einfügen.

Verbindung zu Google Gemini herstellen

Der Prozess für den n8n Google Gemini-Knoten ist sehr ähnlich.

- Knoten hinzufügen: Füge den „Google Gemini“-Knoten zu deinem Workflow hinzu.

- Anmeldedaten hinzufügen: Erstelle neue Anmeldedaten mit deinem Google Gemini-API-Schlüssel.

- Den Knoten konfigurieren: Wähle das Modell (z. B.

gemini-pro) aus und gib deinen Prompt ein. Die Schnittstelle ist so gestaltet, dass sie über verschiedene KI-Modellintegrationen hinweg konsistent und intuitiv bleibt.

Verbindung zu anderen LLMs herstellen

Was, wenn du ein kleineres, Open-Source-Modell selbst betreibst oder einen anderen kommerziellen Anbieter nutzen willst, der keinen eigenen Knoten hat? Du kannst jedes beliebige n8n-LLM mit dem generischen „HTTP Request“-Knoten verbinden.

- Knoten hinzufügen: Füge den „HTTP Request“-Knoten hinzu.

- Die Anfrage konfigurieren:

- Methode: Auf

POSTsetzen. - URL: Gib den API-Endpunkt des LLMs ein, das du aufrufen möchtest.

- Authentifizierung: Wenn deine API einen Authentifizierungsheader (z. B. ein Bearer Token) benötigt, füge ihn unter „Authentication“ > „Header Auth“ hinzu.

- Body: Aktiviere die Option „Body senden“. Wähle im Abschnitt „Body Content Type“ die Option „JSON“ aus. Hier erstellst du die Request Payload, die in der Regel den Modellnamen und den Prompt enthält. Die genaue Struktur hängt von der jeweiligen API-Dokumentation ab. Zum Beispiel:

- Methode: Auf

{

"model": "mistral-7b-instruct",

"messages": [

{

"role": "user",

"content": "{{ $json.prompt }}"

}

]

}Diese Methode gibt dir maximale Flexibilität, um jedes KI-Modell in deine n8n-Workflows zu integrieren.

Praktische AI-Workflow-Beispiele: Inhaltserstellung, Datenanalyse und mehr

Lass uns von der Theorie zur Praxis übergehen. Hier sind einige reale Beispiele für KI-Workflows, die du sofort umsetzen kannst.

Workflow 1: Automatisierte Inhaltserstellung

Dieser n8n-Workflow kann aus einem einfachen Thema einen strukturierten Entwurf erstellen und dir so Stunden an Vorarbeit sparen.

- Trigger: Starte mit einem „Manual“ Trigger, um den Workflow zu testen. Die Eingabe kann ein JSON-Objekt mit einem Thema sein:

{"topic": "Die Vorteile beim Self-Hosting eines VPNs"}, Oder nutze einfach einen „Chat Trigger“-Knoten. - Gliederung erstellen: Gib das Thema an einen OpenAI-Knoten weiter mit einem Prompt wie: „Erstelle eine detaillierte Gliederung für einen Blogpost zum Thema:

{{ $json.topic }}„. Die Gliederung sollte eine Einleitung, 3-4 Hauptabschnitte mit Unterpunkten und einen Schluss enthalten. Antworte im JSON-Format.“ - Abschnittsinhalte generieren: Verwende einen „Split Out“-Knoten, um jeden Hauptabschnitt aus der Gliederung einzeln zu verarbeiten. Für jeden Abschnitt rufst du den OpenAI-Knoten erneut auf mit einem Prompt wie: „Schreibe einen 300-Wörter-Abschnitt für einen Blogpost basierend auf folgendem Gliederungspunkt:

{{ $json.section_title }}. Halte den Ton hilfreich und direkt.“ - Entwurf zusammenstellen: Kombiniere den generierten Inhalt aller Abschnitte mit einem „Merge“-Knoten.

- Entwurf speichern: Nutze den „Google Docs“-Knoten, um ein neues Dokument in deinem Google Drive zu erstellen und den fertigen Entwurf dort zu speichern.

Workflow 2: Intelligente Datenanalyse und Zusammenfassung

Dieser Workflow kann Rohdaten analysieren und dir verständliche Erkenntnisse liefern.

- Trigger: Verwende den „Google Sheets“-Trigger, um den Workflow jedes Mal auszuführen, wenn eine neue Zeile in einem bestimmten Blatt mit Kundenfeedback hinzugefügt wird.

- Feedback analysieren: Übergebe den Feedback-Text an einen Gemini-Knoten mit dem Prompt: „Analysiere das folgende Kundenfeedback:

{{ $json.feedback }}. Ermittle die Stimmung (positiv, negativ oder neutral), identifiziere die wichtigsten Themen und gib eine kurze Zusammenfassung in einem Satz. Antworten Sie im JSON-Format mit den Schlüsseln:sentiment,topics,summary.“ - Tabelle anreichern: Verwende den „Google Sheets“-Knoten erneut, diesmal im „Update“-Modus, um Stimmung, Themen und Zusammenfassung in die passende Zeile zurückzuschreiben.

- Warnung bei negativem Feedback: Füge einen „IF“-Knoten hinzu, um zu prüfen, ob die Stimmung „Negativ“ ist. Falls ja, nutze den „Slack“-Knoten, um sofort eine Benachrichtigung mit einem Link zur entsprechenden Feedback-Zeile an den Support-Channel zu schicken.

Dies ist ein leistungsstarker n8n-AI-Workflow, der eine einfache Tabelle in ein intelligentes Feedback-Analysesystem verwandelt.

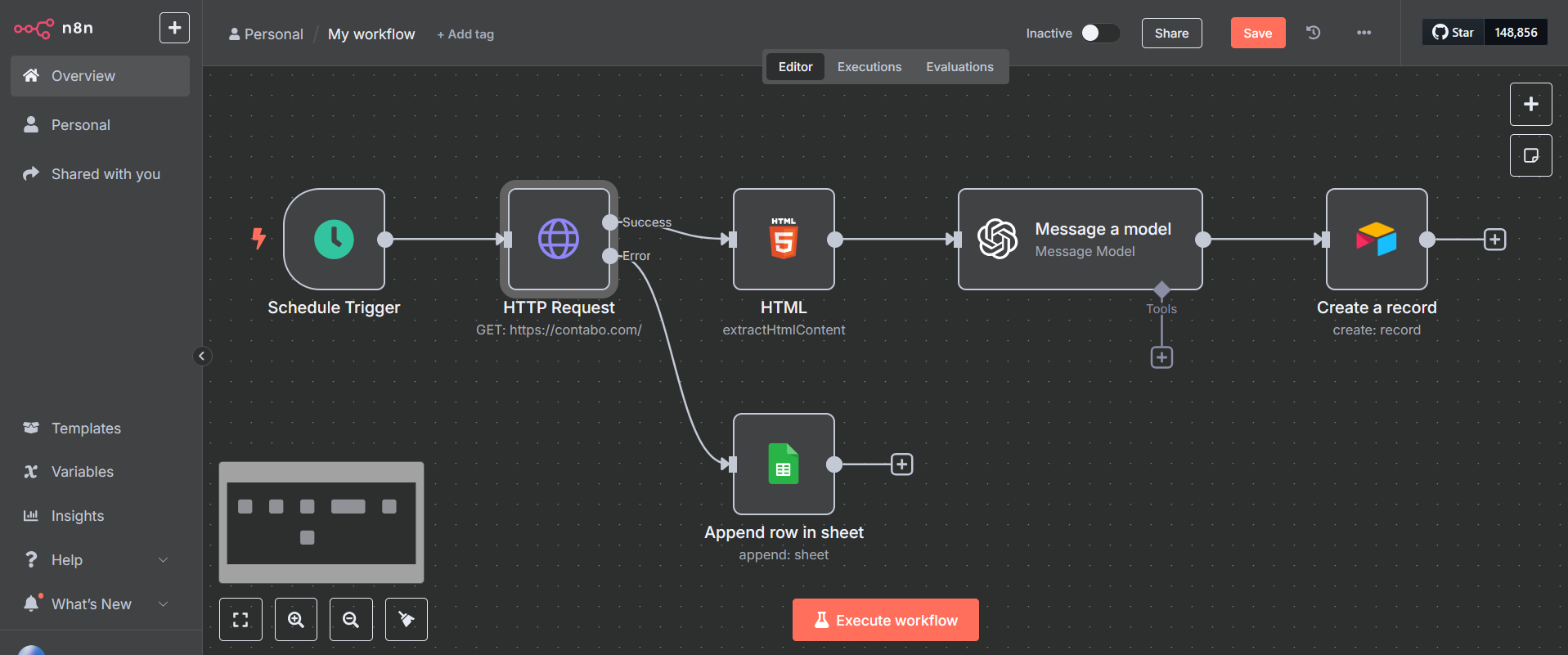

KI-gestützte Web-Scraping- und Datenpipeline aufbauen

Kombiniere mehrere dieser Konzepte in einem einzigen leistungsstarken Projekt: Eine Pipeline, die Webseiten auf neue Informationen überwacht, KI nutzt, um sie zu verstehen, und sie anschließend als strukturierte Daten speichert.

Das Ziel: Den Prozess der Marktforschung automatisieren indem du Nachrichtenartikel zu einer bestimmten Branche sammelst und daraus eine saubere, durchsuchbare Datenbank mit Erkenntnissen aufbaust.

Workflow-Gliederung

- Trigger und URLs abrufen: Starte mit dem „Schedule Trigger“-Knoten, damit der Workflow automatisch ausgeführt wird. Du kannst diesen Knoten so konfigurieren, dass er in jedem beliebigen Intervall ausgeführt wird – zum Beispiel einmal täglich um 9:00 Uhr morgens. Dieser Trigger leitet zu einem Schritt weiter, der eine Liste von Zielseiten aus einem Google Sheet oder einer Airtable-Datenbank abruft.

- Inhalt scrapen: Das native Web-Scraping in n8n erfolgt in der Regel in zwei Schritten. Zuerst nutzt du den „HTTP Request“-Knoten, um eine

GET-Anfrage an die jeweilige Artikel-URL zu senden. Damit rufst du das rohe HTML der Seite ab. Im nächsten Schritt übergibst du dieses HTML an den „HTML“-Knoten. Innerhalb dieses Knotens stellst du die Operation „Extract HTML Content“ ein. Diese leistungsstarke Funktion erlaubt es dir, mit CSS-Selektoren (z. B.h1,.article-body poder#main-content) genau die Inhalte herauszuziehen, die du brauchst – etwa den Titel und den eigentlichen Artikeltext.

Hinweis: Du kannst auch aus einer Vielzahl von Drittanbieter-Knoten für Web-Scraping wählen, jeder mit eigener Funktionalität. Es gibt oft mehr als einen Weg, um Dinge mit n8n zu erledigen. - Mit KI für die Strukturierung verarbeiten: Übergib den extrahierten Text an einen n8n-KI-Knoten (z. B. OpenAI). Hier findet die echte Intelligenz statt. Verwende eine sorgfältig formulierte Eingabeaufforderung, um die KI als Datenanalyst agieren zu lassen:

„Extrahiere aus dem folgenden Artikeltext die folgenden Informationen im JSON-Format: company_names_mentioned, key_technologies_discussed, publication_date und eine 200-Wörter-Zusammenfassung. Wenn eine Information nicht vorhanden ist, gib null für diesen Key zurück.“ - Strukturierte Daten speichern: Der KI-Knoten gibt sauberes, strukturiertes JSON aus, das direkt gespeichert werden kann. Füge dafür einen Datenbankknoten wie den „Airtable“-Knoten hinzu.

- Den Knoten konfigurieren: Wähle deine Airtable-Anmeldeinformationen aus und setze die Operation auf „Create“. Wähle die Basis und die Tabelle, in der du die Ergebnisse speichern möchtest.

- Die Felder abgleichen: Der Knoten zeigt die Felder aus deiner Airtable-Tabelle an. Gleiche nun die Daten aus der KI-Ausgabe mit diesen Feldern ab. Für ein Feld in Airtable mit dem Namen „Companies“ fügst du den

company_names_mentioned-Wert aus der Ausgabe des KI-Knotens hinzu. So könnte es ungefähr aussehen:{{ $json.company_names_mentioned }}. Wiederhole das für alle Daten, die du extrahiert hast.

- Überprüfung und Fehlerbehandlung (Optional): Workflows können fehlschlagen, vor allem wenn externe Webseiten oder APIs beteiligt sind. Es ist wichtig, hier Resilienz einzubauen.

- Fehlerquellen identifizieren: Die „HTTP Request“- und die „AI“-Knoten sind die wahrscheinlichsten Punkte, an denen etwas schiefgehen kann (z. B. Website down, API-Key ungültig).

- Inline-Fehlerprotokollierung einrichten: Klicke auf den „HTTP Request“-Knoten, gehe zum Tab Einstellungen und stelle „Continue (using error output)“ ein. Der Knoten hat jetzt zwei Ausgänge: Erfolg (oben) oder Fehler (unten).

- Einen Fehlerpfad erstellen: Verbinde den unteren „Error“-Ausgang mit einem „Google Sheets“-Knoten. Konfiguriere diesen Knoten so, dass eine neue Zeile ans Log-Sheet angehängt wird. In den Feldern kannst du die URL, die fehlgeschlagen ist, und die genaue Fehlermeldung zuordnen, die im Ausdrucks-Editor unter verfügbar ist. So entsteht ein einfaches, aber effektives Protokoll aller URLs, die nicht verarbeitet werden konnten, und du kannst sie später prüfen, ohne dass der ganze Workflow stoppt. Dasselbe Muster kannst du auf jeden anderen fehleranfälligen Knoten anwenden.

Dieser Workflow ist ein perfektes Beispiel dafür, wie n8n einen komplexen Prozess orchestrieren kann und KI die Lücke zwischen unstrukturierten Webinhalten und einem strukturierten, wertvollen Datensatz schließt.

Von API zu Automatisierung: Eigene n8n-KI-Workflows erstellen

Die vorgefertigten Knoten sind mächtig, aber das wahre Potenzial von n8n zeigt sich, wenn du es als programmierbares Automatisierungs-Backend nutzt. Durch die Interaktion mit der n8n-API kannst du eigene Workflows bauen, die nahtlos in deine Anwendungen und Services integriert werden.

Stell dir vor, du hast ein selbstgebautes CRM. Du könntest einen Button in deinem CRM hinzufügen, der beim Klick einen n8n-Workflow auslöst, der eine KI-Analyse der bisherigen Kundendaten macht. So richtest du es ein:

- Webhook-Trigger erstellen: Starte deinen Workflow mit dem „Webhook“-Knoten. Das generiert eine eindeutige URL.

- KI-Logik aufbauen: Baue den Rest des Workflows, um die gewünschte Aufgabe zu erledigen. Beispiel: Alle bisherigen Support-Tickets einer Kunden-ID abrufen, sie an ein n8n-LLM weitergeben mit der Aufforderung „Fasse die 3 wichtigsten Probleme des Kunden und die allgemeine Stimmung zusammen“ und dann die Zusammenfassung in einen Slack-Kanal posten.

- Webhook aus deiner App aufrufen: Mach im Anwendungscode eine

POST-Anfrage an die Webhook-URL, wann immer der Button gedrückt wird. Die Kunden-ID wird im Body der Anfrage übergeben. Hier ist ein Beispiel mitcurl:

curl -X POST -H "Content-Type: application/json" -d '{"customerId": "12345"}' https://your-n8n-instance.com/webhook/your-webhook-idDieser Ansatz ermöglicht es dir, KI-gestützte Automatisierungen direkt in deine bestehenden Tools einzubetten und so eine nahtlose Nutzererfahrung zu schaffen. Du bist nicht mehr auf die integrierten Auslöser beschränkt – deine eigenen Anwendungen können jetzt als Ausgangspunkt für jeden Workflow dienen.

n8n AI Workflows FAQ

- Welche Kosten entstehen bei der Nutzung von KI-Modellen in n8n?

n8n selbst erhebt keine zusätzlichen Gebühren für die Nutzung seiner KI-Knoten. Du bist jedoch für die Kosten verantwortlich, die vom Anbieter des KI-Modells berechnet werden. Wenn du z. B. den OpenAI-Knoten verwendest, stellt dir OpenAI die Nutzung basierend auf (der Anzahl der verarbeiteten Tokens) in Rechnung. - Sind meine Daten sicher, wenn ich n8n mit KI nutze?

Das ist ein wichtiger Punkt. Wenn du ein Cloud-basiertes KI-Modell wie OpenAI oder Gemini nutzt, werden die Daten, die du in deiner Anfrage sendest, auf deren Servern verarbeitet. Obwohl diese Unternehmen strenge Datenschutzrichtlinien haben, verlassen die Daten trotzdem deine eigene Infrastruktur. Für maximale Sicherheit und Datenschutz ist die beste Lösung, ein selbst gehostetes Open-Source-LLM auf deinem eigenen Server zu verwenden und es über den HTTP-Request-Knoten aufzurufen. - Kann ich Open-Source-LLMs mit n8n verwenden?

Auf jeden Fall. Wenn du ein Open-Source-Modell lokal oder auf deinem eigenen Server betreibst (z. B. mit einem Tool wie Ollama), stellt es in der Regel einen API-Endpunkt bereit. Du kannst den „HTTP Request“-Knoten in n8n nutzen, um diesen Endpunkt aufzurufen. So bekommst du die Leistung moderner LLMs bei voller Kontrolle über deine Daten.