Einleitung

Das Thema Backup ist heutzutage wichtiger denn je. Tagtäglich passieren massive, professionell durchgeführte Angriffe auf Unternehmen mit dem Ziel, Daten zu verschlüsseln und Lösegeld zu fordern. Nicht selten werden die Daten auch direkt gelöscht mit dem Ziel, möglichst viel Schaden zu erzeugen. In solchen Situationen zahlt es sich aus, wenn man proaktiv seine Backup-Infrastruktur auf Vordermann gebracht und sich für solche Szenarien vorbereitet hat. Dieser Artikel beschreibt den Aufbau und die Optimierung von solch einer Umgebung in Zusammenhang mit Veeam Backup & Replication von der Firma Veeam Software.

Veeam als Backup Software

Wer mich kennt weiß, dass ich schon seit Jahren ein großer Fan von Veeam Software und deren Produkten bin. Mit dem Release 6.5 wurde damals der Support für Microsoft Hyper-V eingeführt, seitdem nutze ich Veeam nahezu täglich. Die Software ist eine der ganz wenigen Beispiele am Markt, bei dem ein Hersteller so viel Arbeit und Zeit in die Qualitätskontrolle seines Produktes steckt. Natürlich gibt es bei neuen Versionen immer mal wieder kleinere Probleme, aber ich habe noch in keinem Fall nach der Installation von einer neuen Version so viele Probleme gehabt, dass ich die Software zurücksetzen musste oder das es Datenverlust mit älteren Backups gab. Viele Funktionen innerhalb der Software, die man mittlerweile auch in anderen Produkten nutzen kann, wurden erstmals durch Veeam entwickelt und auf den Markt gebracht. Eines dieser Beispiele wäre die Funktion „Instant Recovery“, bei der Sie eine oder mehrere VMs aus dem Backup heraus innerhalb von Minuten wieder starten können. Wir gehen im weiteren Verlauf des Artikels noch genauer auf diese Funktion ein, weil sie bei einem Disaster Recovery eine tragende Rolle spielen kann.

Nutzen Sie bei sich im Unternehmen eine andere Backup-Software, kann dieser Artikel trotzdem sehr interessant für Sie sein, da viele der angesprochenen Themen allgemein gültig sind und auch in anderen Produkten zum Einsatz kommen. Da ich aber primär mit Veeam Backup & Replication arbeite, bezieht sich dieser Artikel primär auf diese Software.

Ein genauer Blick auf den Backup-Speicher

Bei der Wahl des Backup-Speichers gibt es einige Dinge, die beachtet werden sollten. Häufig wird eine gewisse Menge an Festplatten zu einem RAID-Verbund zusammengefasst und dann als Backup-Ziel genutzt. Je nach Größe der Umgebung und Menge der Daten kann dies ein NAS-Speicher sein, ein eigener Server oder ein oder mehrere SAN-Systeme. Genau an dieser Stelle möchte ich ansetzen und die verschiedenen Möglichkeiten zur Optimierung besprechen.

Bei Contabo können Sie einen oder mehrere Server mieten, sie mit der gewünschten Menge und Größe an Speicherplatz ausstatten und sie mit einem Raid versehen, um sie als Backup-Server zu verwenden.

Die Größe des Speichers

Der Bedarf an Backupspeicher wird durch viele Faktoren beeinflusst. Dies sind unter anderem die aktuelle Größe der Daten, die Anzahl an Speicherpunkten, das tägliche Delta, das jährliche Wachstum der Daten und noch vieles mehr.

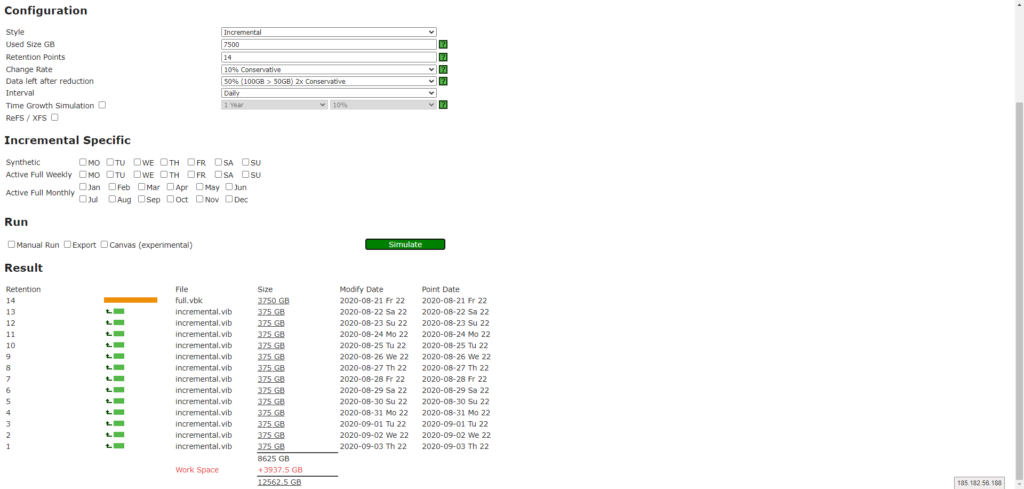

Um den Bedarf möglichst realistisch planen zu können, gibt uns Veeam ein paar Tools an die Hand. Eins dieser Tools ist der „Retention Point Calculator“, der unter https://rps.dewin.me/ online steht. Der Rechner kann mit Daten gefüttert werden und wirft dann am Ende als Ergebnis die benötigte Größe an Speicherplatz hinaus. Hierbei können Sie auch unterschiedliche Arten und Kombinationen von Backups berechnen, z.B. 14 tägliche und dann weitere strategische Zeitpunkte jede Woche, jeden Monat usw.

Die benötigte Zeit

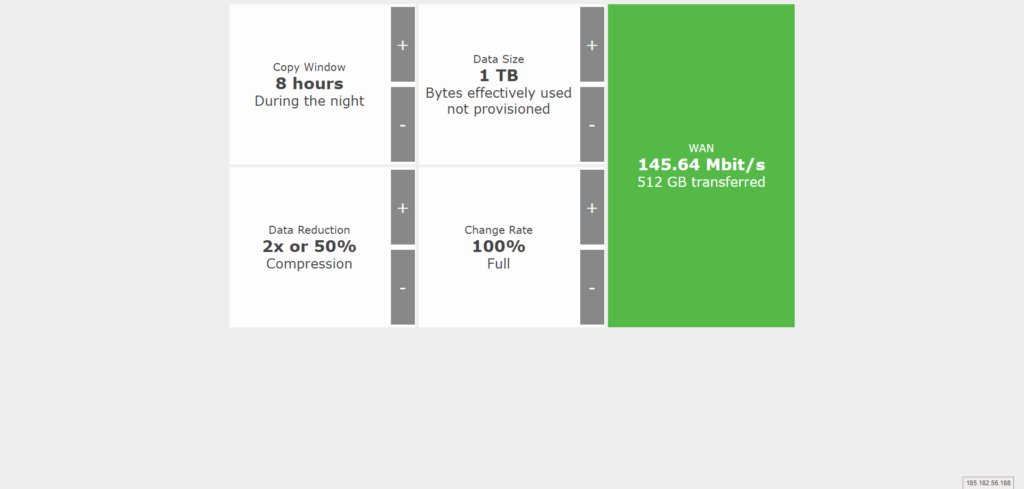

Nicht selten muss ein Backup innerhalb von einem gewissen Zeitfenster abgeschlossen sein, damit es keinen aktiven Workload beeinflusst oder Netzwerk-Strecken auslastet und für eine negative Beeinflussung des Tagesgeschäfts sorgt. Hierbei sind mehrere Dinge zu berücksichtigen. Zum einen wäre dies die benötigte Bandbreite, die vorhanden sein muss. Hierfür gibt es ebenfalls einen Simulator, der unter http://rps.dewin.me/bandwidth/ erreichbar ist.

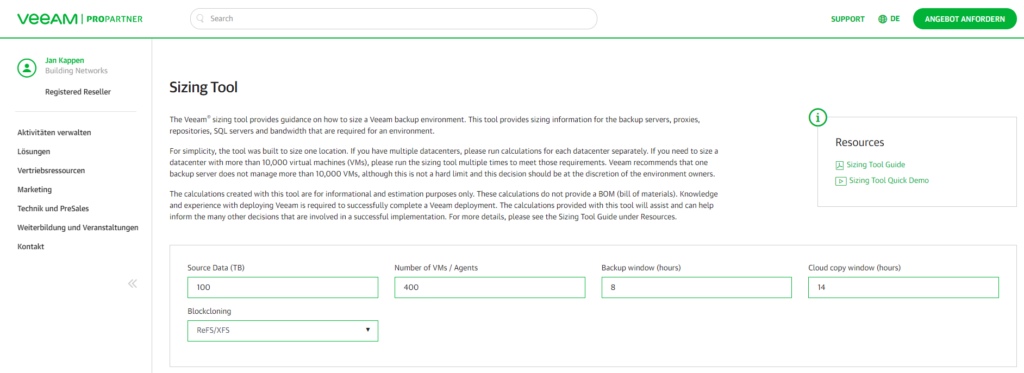

Je größer die Infrastruktur, desto mehr Daten müssen bewegt werden. Sie brauchen hier CPU-Leistung, Arbeitsspeicher und Netzwerkbandbreite. Auch dies kann vorab geplant werden, das entsprechende Tool ist mittlerweile allerdings nur noch über die Veeam Hauptseite verfügbar: https://propartner.veeam.com/vm-sizing/

Die Kombination von Speicher

Bei der Planung des Backups ist es mittlerweile keine Seltenheit mehr, dass unterschiedliche Typen von Speicher kombiniert werden, um die besten Eigenschaften zu kombinieren. Hierbei wird Flash-Speicher in Form von SSDs oder NVMes für Geschwindigkeit genutzt, während klassische Festplatten für viel Speicherplatz sorgen. Alternativ kann auch Blockspeicher hinzugefügt werden, wir kommen im weiteren Verlauf des Artikels noch auf dieses Thema zu sprechen.

Flashspeicher für mein Backup?

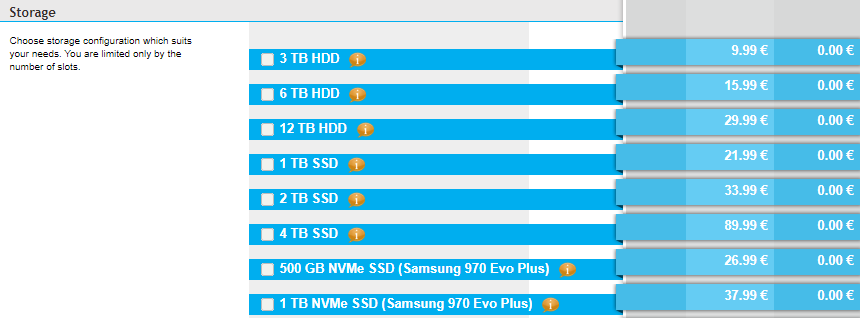

Die Preise für SSDs und NVMe-Datenträger sind in den letzten Jahren immer weiter gesunken und mittlerweile auf einem Niveau, wo sie auch als kurzfristigen Speicher für Backups in Frage kommen. Bei Contabo sind zum Beispiel SSD- und NVMe-Speicher nur 6,8x und 15,2x teurer als herkömmlicher HDD-Speicher. Kurzfristig heißt, dass die Backups nur wenige Tage auf diesem schnellen Speicher abgelegt werden, bevor sie dann auf langsameren Speicher verschoben werden. Dies sorgt aber dafür, dass Wiederherstellungen deutlich schneller abgeschlossen werden können, weil der genutzte Speicher einfach signifikant schneller ist als drehende Spindeln.

Bei Contabo haben Sie die Wahl zwischen 500 GB oder 1 TB NVMe Speicher, je nach Anforderung. Die Preise mit Stand Oktober 2020 sehen wie folgt aus:

Veeam Instant Recovery

Durch die „Instant Recovery“ Technik haben Sie die Möglichkeit, VMs direkt aus dem Backupspeicher heraus zu starten. So können Sie virtuelle Server innerhalb weniger Minuten wieder in Betrieb nehmen, ohne vorab alle Daten zurück auf den Server bzw. das SAN-System zu übertragen. Je nach Größe von VMs erspart Ihnen dies mehrere Stunden bis hin zu Tagen an Downtime.

Flashspeicher sorgt dafür, dass Sie in Summe mehr virtuelle Server gleichzeitig aus dem Backup heraus starten können, ohne dass die Performance so schlecht wird, dass eine Arbeit mit dem System nicht mehr möglich ist. Hier hat die Art der Datenträger, die Anzahl und die Größe einen großen Einfluss auf die Menge an VMs, die mittels „Instant Recovery“ Technologie online geschaltet werden können. Die optimale Größe sollte während der Planungsphase besprochen und berechnet werden. Hier spielt es auch eine wichtige Rolle, welche virtuellen Server Sie in einem Notfall wirklich benötigen und welche Systeme zweitrangig sind bzw. nicht innerhalb kurzer Zeit wiederhergestellt werden müssen. Je weniger VMs Sie zeitkritisch wiederherstellen müssen, desto kleiner kann dieser Speicherbereich sein.

Nachgelagerter Speicher – groß und günstig

Erfahrungsgemäß ist es so, dass bei einem Backup eine Wiederherstellung immer unwahrscheinlicher wird, je älter das Backup ist. Dies machen wir uns zum Vorteil und verschieben die Backups nach einiger Zeit automatisiert auf einen Speicherbereich, der nicht aus SSDs/NVMes besteht. Handelt es sich um normale Festplatten, bekommen Sie hier massiv viel Speicherplatz zu einem sehr attraktiven Preis und können die Backups so trotzdem für Wochen, Monate oder sogar Jahre aufbewahren. Möglich ist hier auch die Nutzung von speziellem Dedup-Speicher, bei dem die Daten automatisch dedupliziert werden. So kann selbst mit verhältnismäßig wenig Speicherplatz trotzdem jahrelang gesichert oder archiviert werden.

Bei einer möglichen Wiederherstellung von Daten wäre dies natürlich deutlich langsamer als bei Flashspeicher, da es aber mit steigendem Backup-Alter immer unwahrscheinlicher wird, dass Daten wiederhergestellt werden müssen, wird dies in den meisten Fällen in Kauf genommen. Wenn Sie einem Kollegen eine große Datei von vor neun Monaten wiederherstellen können und dies nun zwei Stunden statt 15 Minuten dauert, ist er darüber vermutlich glücklicher sein als wenn Sie ihm sagen müssen, dass die Wiederherstellung nicht möglich ist, weil nicht genügend Speicherplatz für neun Monate Backups zur Verfügung steht.

Die Demo-Umgebung

Die Einrichtung innerhalb von Veeam zeige ich anhand einiger Screenshots in meiner Demo-Umgebung. Es existieren mehrere Server, hier eine kurze Beschreibung der Systeme und deren Ausstattung.

Veeam Management Server

Das Management-System ist der primäre Server. Auf dem System ist ein Windows Server 2019 in der Standard Edition installiert inkl. grafischer Oberfläche. Hier ist Veeam Backup & Replication in der zurzeit aktuellsten Version 10.0.1.4854 installiert. Das System wird zur Administration genutzt, auf dem Server selbst laufen keine weiteren VMs, Rollen oder Dienste. Der Server selbst hat nur ein RAID1 für das Betriebssystem, keine weiteren Datenträger.

Für solch ein System eignet sich ein Modell der „Outlet Server“ Reihe von Contabo sehr gut, da er preislich attraktiv ist und keine allzu hohen Ansprüche an die Leistung des Systems stellt. Sie sollten nur darauf achten, das Upgrade auf 1 Gbps zu aktivieren, 100 Mbps sind nicht mehr zeitgemäß, auch nicht für einen Veeam Management Server.

Veeam Storage Host 1

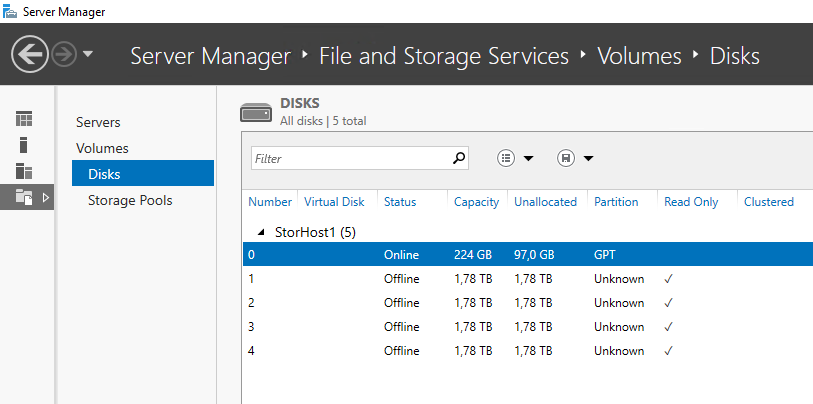

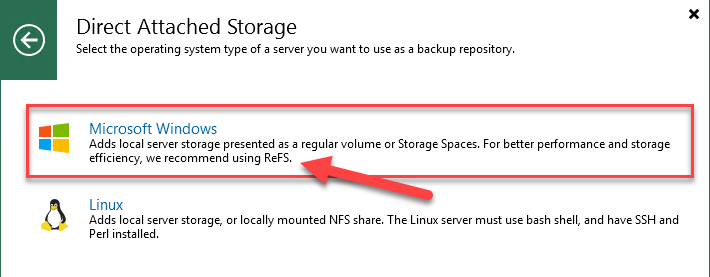

Dieses Hardware-System enthält zwei Festplatten im RAID1 für das (Windows Server 2019 Standard) Betriebssystem sowie vier NVMe-Datenträger. Da die Datenträger nicht an einem RAID-Controller betrieben werden, sind diese im Betriebssystem mittels Storage Spaces-Technologie zu einem Speicherpool zusammengefasst.

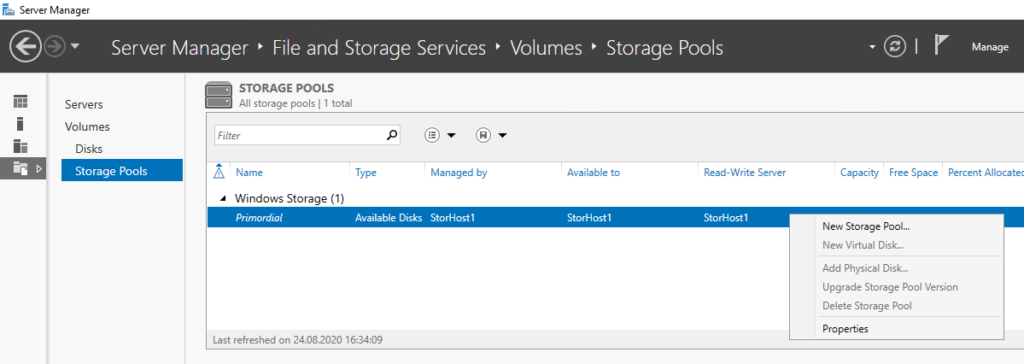

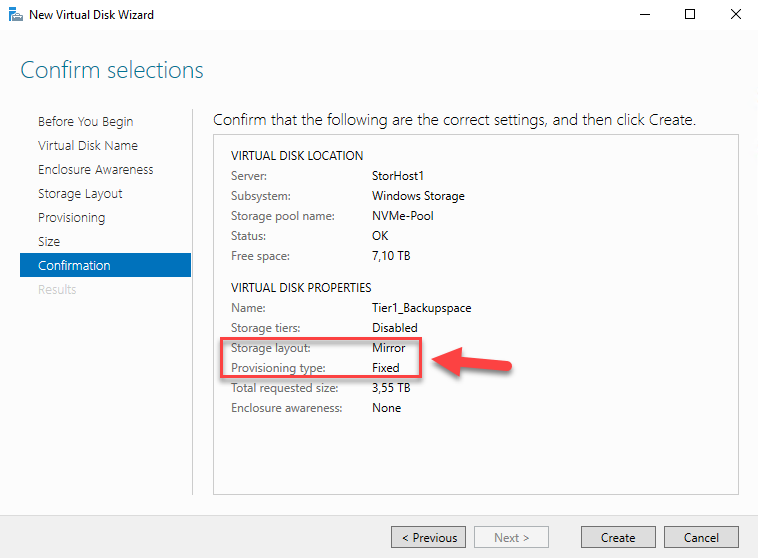

Die Datenträger werden zu einem Speicherpool zusammengefasst, basierend auf diesem Pool wird dann ein Volume erstellt. Wir achten bei der Erstellung darauf, dass bei Layout „Mirror“ ausgewählt ist und der Provisioning Type auf „Fixed“ steht. Dies garantiert die beste Performance gepaart mit einer Ausfallsicherheit. Es wäre sehr ärgerlich, wenn unsere wichtigen Backup-Daten direkt unwiderruflich zerstört wären, wenn einer der Datenträger ausfällt.

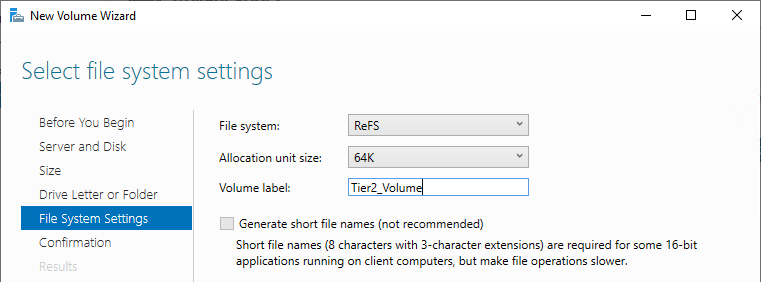

Um den neu erstellten Datenträger nutzen zu können, müssen wir ein Dateisystem auf das Volume bringen. Hier bietet sich ReFS an. Veeam arbeitet sehr gut mit ReFS zusammen und profitiert von Eigenschaften wie z.B. Block Cloning. Achten Sie ebenfalls darauf, die Allocation Unit Size auf 64K zu setzen, statt auf dem Standard-Wert zu belassen.

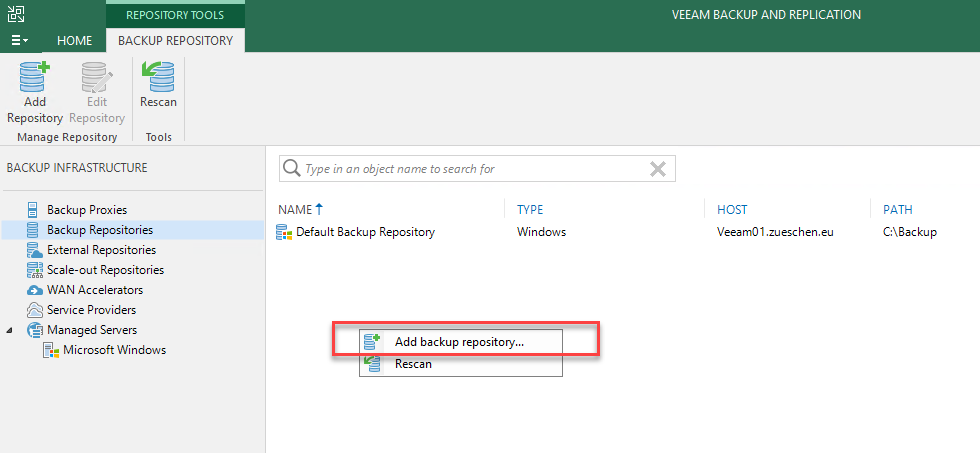

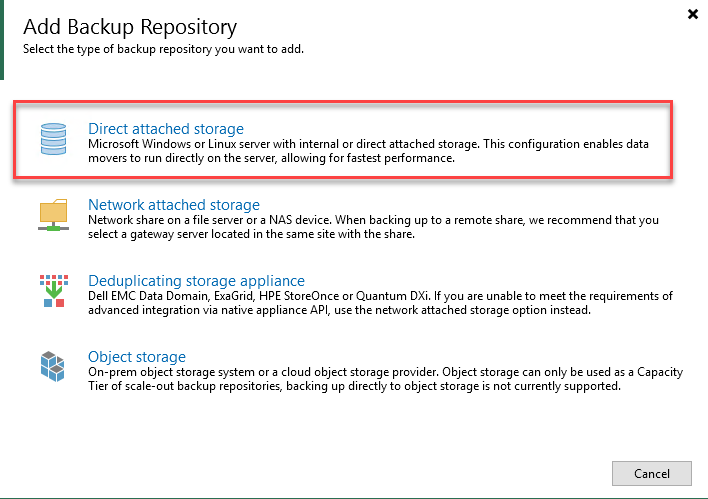

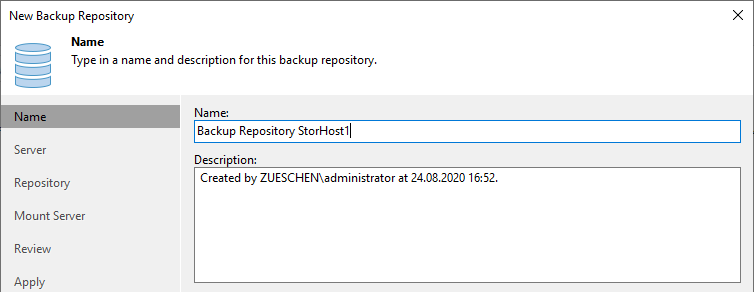

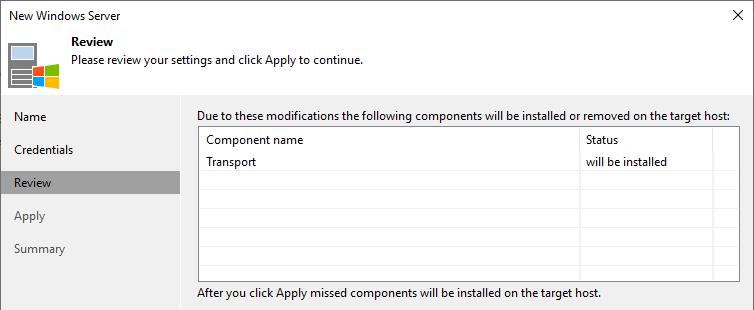

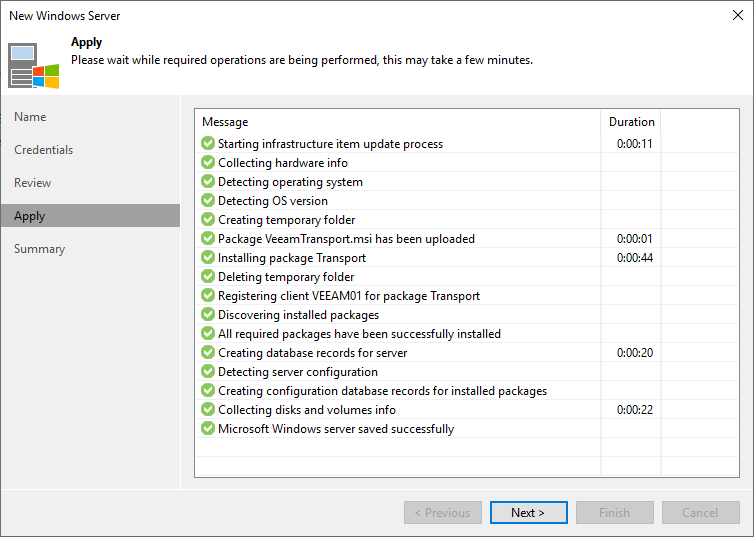

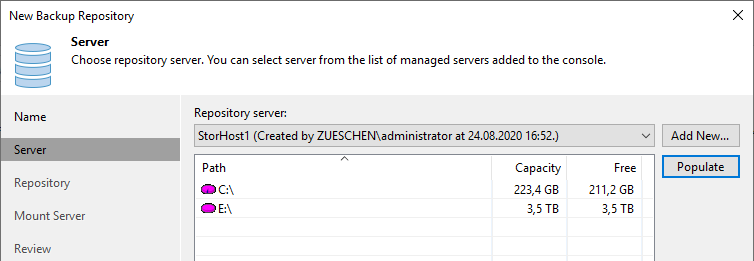

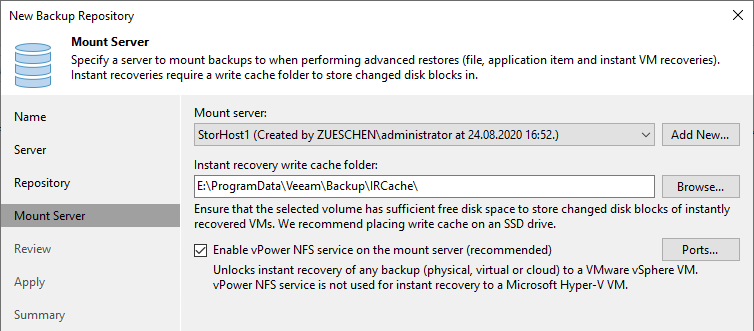

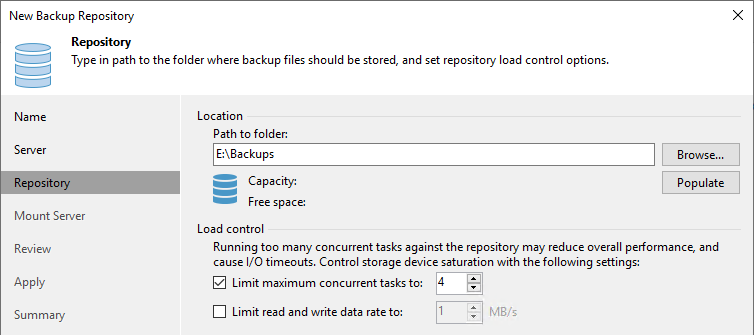

Nun kann der Server über die Veeam-Konsole als Backup Repository aufgenommen werden.

Zu diesem Zweck wird der 32-Core AMD Dedicated Server von Contabo empfohlen. Hier haben Sie die Möglichkeit, zusätzlich zu normalen Festplatten SSDs und/oder NVMes zu konfigurieren. Darüber hinaus kann durch das 10 Gbps Add-On die Netzwerkbandbreite deutlich erhöht werden, was mehr Bandbreite im Backend und damit eine Verkürzung der Backup-Dauer bedeutet.

Selbst wenn Sie keine 32 Kerne benötigen, kann dieses System viel mehr Platten verarbeiten als kleinere Systeme. Dies macht es einfach, in der Zukunft zu wachsen, ohne ein zusätzliches System hinzuzufügen oder alle vorhandenen Daten auf ein neues System zu migrieren.

Veeam Storage Host 2

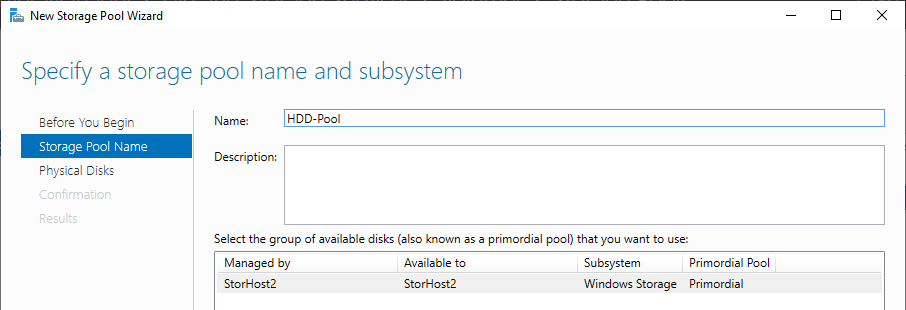

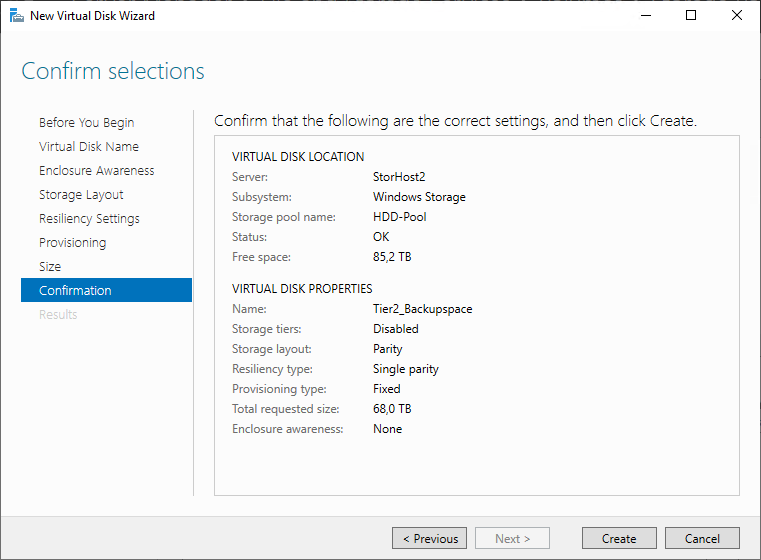

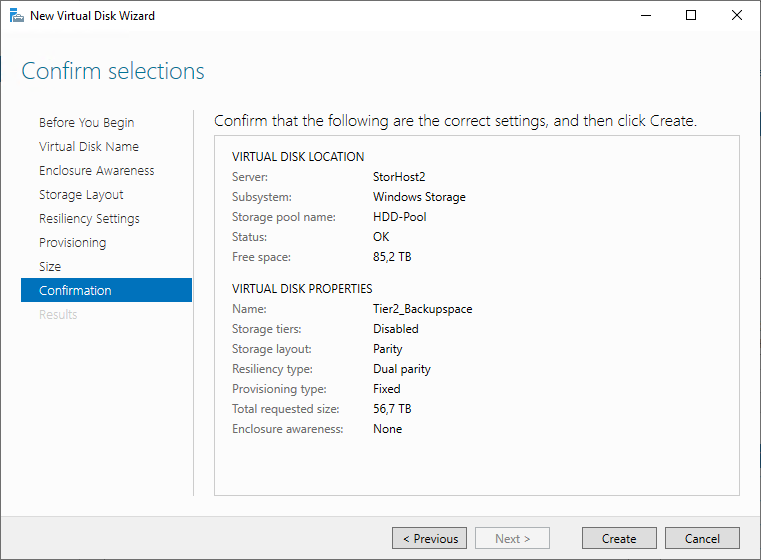

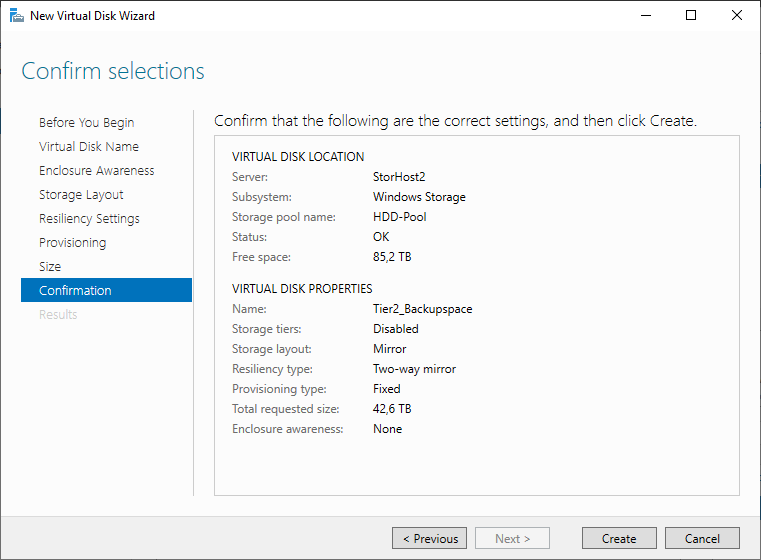

Das zweite System zur Speicherung unserer Daten ist ebenfalls ein Hardware-System. Hier sind zwei kleine Festplatten im RAID1 verbaut, auf dem ebenfalls ein Windows Server 2019 in der Standard Edition installiert ist. Zur Speicherung und Archivierung der Backup-Daten stehen aktuell acht Festplatten mit jeweils 12 TB an brutto-Speicherplatz zur Verfügung. Hierbei können Sie frei wählen, ob Sie einen klassischen RAID-Controller einsetzen oder ebenfalls auf die Storage Spaces-Technologie setzen. Ich in meinem Fall habe keinen RAID-Controller und füge somit alle Datenträger zu einem Speicherpool zusammen, um danach einen virtuellen Datenträger zu erzeugen.

Ich nutze auch hier einen gespiegelten Datenträger, um gegenüber einer Parität noch einen kleinen Geschwindigkeitsvorteil zu haben. Ist dies egal, kann auch durch „Single Parity“ (ähnlich einem RAID5) oder „Double Parity“ (ähnlich einem RAID6) die nutzbare Menge an Speicherplatz weiter erhöht werden.

Das Volume wird ebenfalls mit ReFS und 64k Blocksize formatiert, aus den vorher schon genannten Gründen.

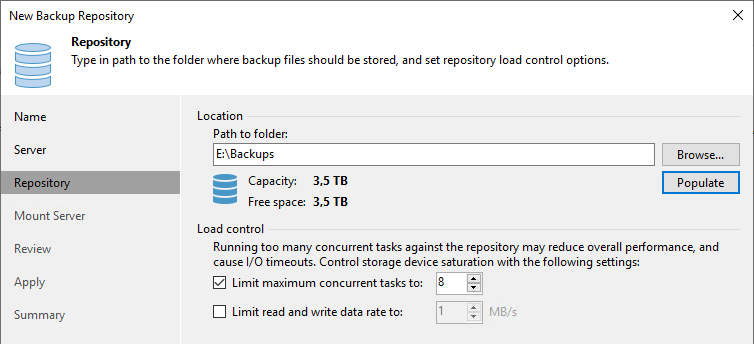

Nun wird der Speicher in Veeam als Backup Repository hinzugefügt, ich achte an dieser Stelle darauf, dass die Anzahl der parallelen Streams geringer ist als bei dem NVMe-Volume.

Aus den bereits erwähnten Gründen wird auch hier ein 32-Core AMD Dedicated Server empfohlen.

Hyperv01

Dies ist unser Hyper-V Host, auf dem die virtuellen Systeme betrieben werden. Als Backup-Quelle kann nicht nur ein einzelner Host verwendet werden, sondern auch weitere Einzel-Hosts, ein oder mehrere Failover Cluster, VMware Sphere oder Nutanix. Die Menge an Servern ist nahezu unbegrenzt, es muss nur jeweils auf die Menge an benötigten Ressourcen geachtet werden, die für die Veeam-Infrastruktur benötigt wird.

Hier müssen Sie einen oder mehrere Server der „Dedicated“ Reihe auswählen, die Ihren Anforderungen entspricht. Diese können eher in Richtung Arbeitsspeicher gehen, in Richtung CPU oder Sie brauchen sehr viele IO-Leistung, je nach Art und Menge der eingesetzten Software. Hier kann keine pauschale Aussage getroffen werden, dies muss im Vorfeld geklärt werden.

Das Thema Netzwerkbandbreite

Die Netzwerk-Anbindung für den Veeam Management Server muss keine allzu hohe Bandbreite haben, grundsätzlich kommt das System mit Minimum 1 Gbps klar. Dies liegt daran, dass auf diesem Server keine Bandbreiten-intensive Prozesse stattfinden, sondern von hier aus „nur“ alle Aufgaben delegiert werden.

Die anderen Systeme, also die Storage Server und die Hypervisor, sollten eine möglichst hohe Bandbreite zur Verfügung haben. Häufig macht der Aufbau von einem dedizierten Backup-Netzwerk Sinn, um zum einen eine möglichst hohe Bandbreite zur Verfügung zu haben und zum anderem, um das Produktiv-Netzwerk nicht zu belasten oder gar zu stören. Bandbreiten von 2x 10 Gbps sind hier Pflicht, ich empfehle meist sogar direkt die Installation und Nutzung von 25 Gbps. Der Preisunterschied zwischen 10 und 25 Gbps ist kaum noch gegeben, daher macht es fast nie Sinn noch mit 10 Gbps Karten zu arbeiten. Der Bedarf lässt sich nicht pauschal klären, grundsätzlich gilt aber: Je mehr Hypervisor im Einsatz, desto höher der Bedarf an Bandbreite und desto eher sollten Sie den Aufbau von einem dedizierten Backup-Netzwerk planen.

Wenn Sie Bedarf an solch einer Konfiguration haben, treten Sie gern mit dem Contabo Support in Kontakt. Hier können Sonderwünsche gerne angebracht und umgesetzt werden.

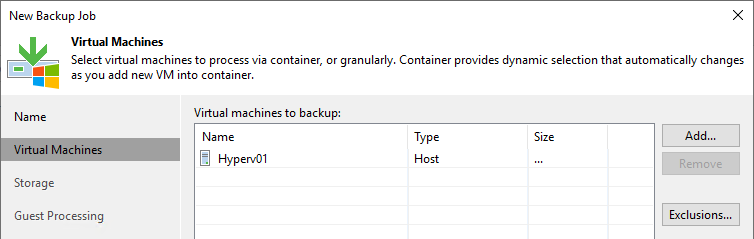

Integration in Veeam

Nachdem alle Server installiert, konfiguriert und in Veeam aufgenommen sind, können wir nun mit der Einrichtung beginnen. Hierzu fügen wir unseren Hyper-V Host im Backup-Job hinzu. Die Aufnahme des gesamten Hosts führt dazu, dass grundsätzlich alle VMs auf dem System gesichert werden, auch wenn neue hinzukommen.

Bei der Nutzung von mehr als einem Backup-Speicher gibt es mehr als eine Möglichkeit, wie wir dies automatisieren können. Dies hängt aber stark von der Art von Backup Speicher ab, der genutzt wird. Bei dem hier genutzten Aufbau muss die folgende Variante mittels Backup-Copy-Job verwendet werden, da wir mit zwei „normalen“ ReFS-Volumes arbeiten.

Die Nutzung eines Backup-Copy-Jobs

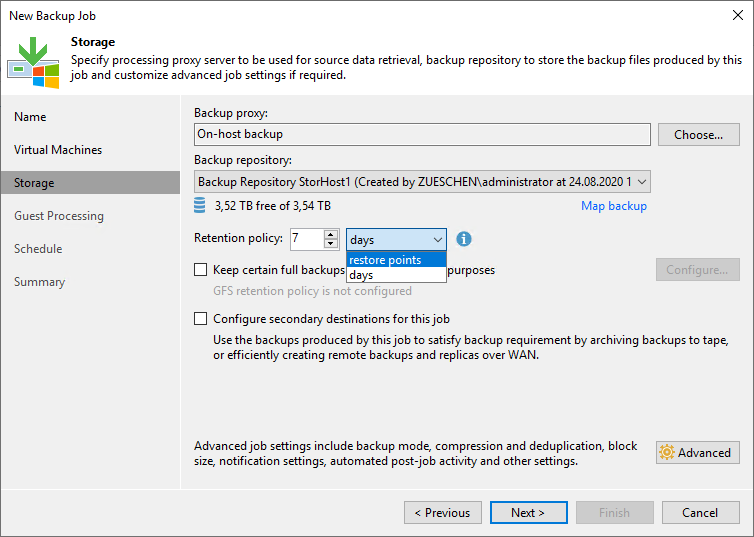

Bei dieser Art von zusätzlicher Archivierung wird im ersten Schritt ein neuer Backup Job angelegt. Als Backup Repository wird nun der NVMe-Speicher ausgewählt, in meinem Fall ist dies der StorHost1. Nun definiere ich die maximale Anzahl an Backup-Punkten oder alternativ die maximale Anzahl an Tagen, die mein Backup auf diesem Speicher abgelegt werden darf.

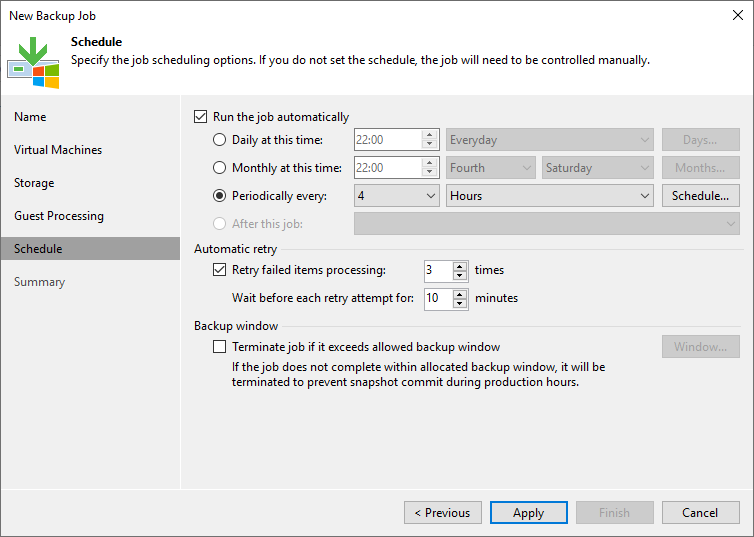

Ich konfiguriere hier 7 Tage, um eine volle Woche speichern zu können. Die Konfiguration eines zweiten Ziels mache ich in diesem Schritt noch nicht, dies ist erst möglich, wenn der Primär-Job angelegt ist. Auf die erweiterten Einstellungen gehe ich an dieser Stelle nicht weiter ein, dies kann nach Bedarf gemacht werden. Unter „Schedule“ muss nun das Intervall eingestellt werden, in dem Sicherungen erstellt und gespeichert werden. Dies ist komplett abhängig von dem Bedarf, beachten Sie hier nur unbedingt die Größe an NVMe-Speicher, die Sie zur Verfügung haben. Zu viele Backups erzeugen zu viel Daten und sprengen ggf. den Speicher.

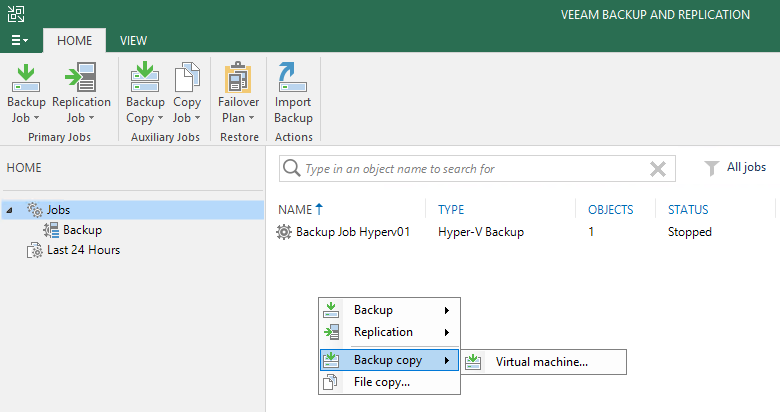

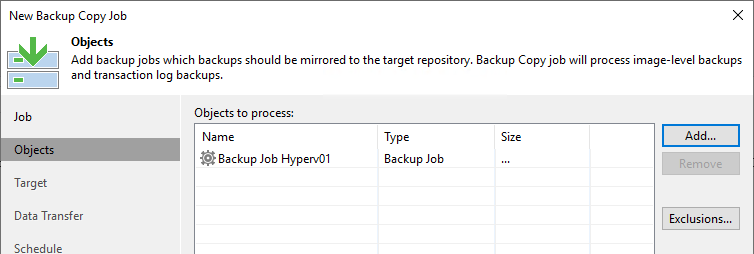

Ist der primäre Job angelegt, können wir nun für eine Kopie der Daten auf den HDD-Speicher sorgen. Dazu erstellen wir nun einen „Backup Copy Job“.

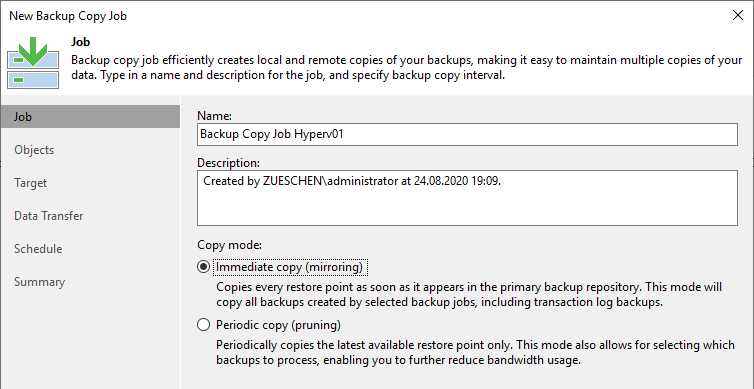

Hier können wir wählen, ob die Kopie sofort nach Fertigstellung des Backup Jobs gemacht wird oder erst zu einem definierten Zeitpunkt.

Als Quelle können wir nun unseren gerade erzeugten Backup-Job angeben.

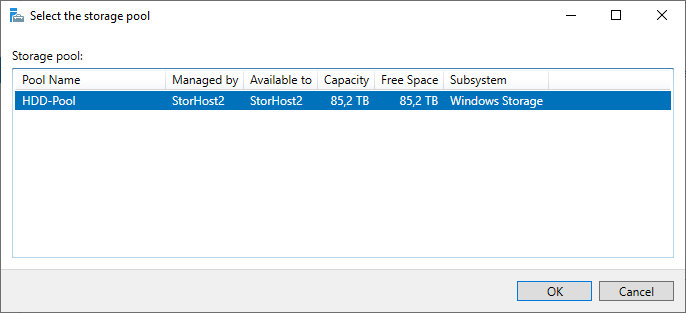

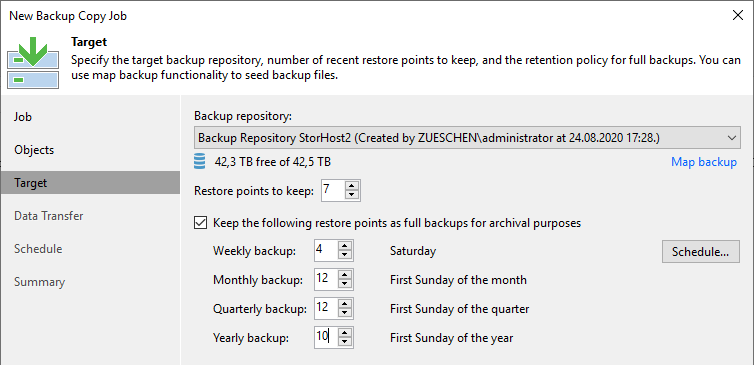

Als Ziel für die Backup-Daten müssen wir nun den StorHost2 mit dem HDD-Speicher. Zusätzlich zu den normalen Restore Points können wir nun an dieser Stelle noch weitere Backups aufbewahren, zu sehen im folgenden Screenshot.

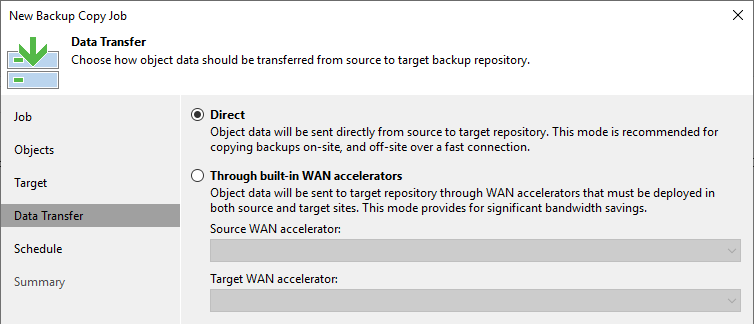

Auf Wunsch können wir die Daten während dem Transfer noch durch einen WAN accelerator schicken, dies ist aber in unserem Fall nicht sinnvoll, da die Storage-Systeme im besten Fall direkt über 10 Gbps oder mehr angebunden sind.

Haben wir ausreichend Performance im Backend oder sogar ein eigenes Backup-Netz, können wir den Transfer zwischen StorHost1 und StorHost2 ruhig zu jeder Zeit laufen lassen. Kommt es möglicherweise zu Engpässen, sollten wir die Kommunikation auf eine Zeit abends bzw. nachts beschränken. Dies ist allerdings widersprüchlich zu der Option „sofortige Backup-Spiegelung“, womit wir wieder bei einem eigenen Backup-Netzwerk sind.

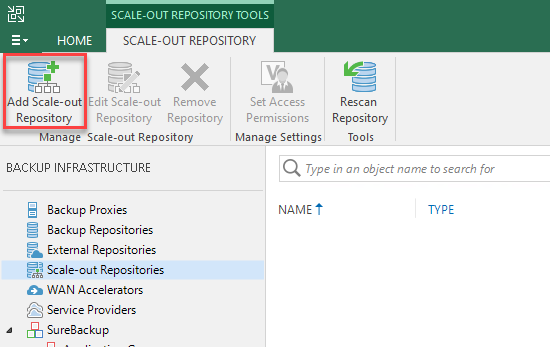

Die Nutzung von einem Scale-Out Backup Repository

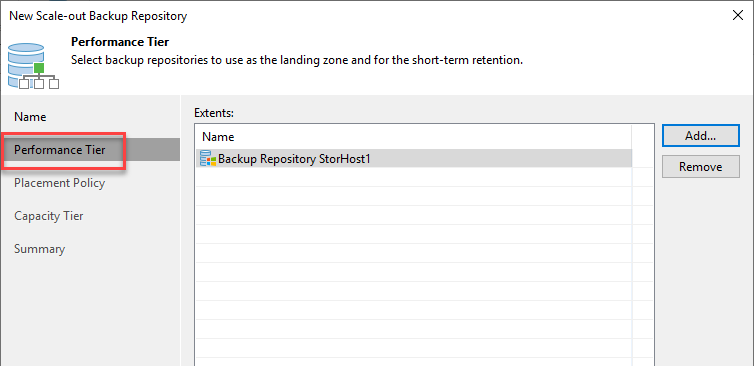

Als zweite Möglichkeit bietet sich ein Scale-Out Backup Repository an. Bei dieser Technik werden zwei Arten von Repos miteinander verknüpft. Die Einrichtung passiert ebenfalls über die Veeam Management-Konsole.

Nachdem wir einen Namen vergeben haben, müssen wir im ersten Schritt den „Performance Tier“ auswählen. Dies ist in meinem Fall der NVMe-Speicher in StorHost1.

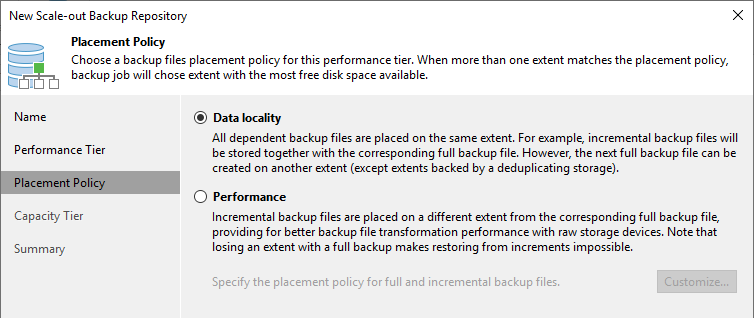

Nun können Sie wählen, ob die Backup-Daten einer VM immer auf dem gleichen Speicher abgelegt wird oder ob es möglichst schnell gehen soll und die Daten „irgendwo“ gespeichert werden. Bei nur einem Repo im Performance Tier ist es egal, diese Einstellung ist erst relevant bei zwei oder mehr Repos. Vorteil der „Data locality“-Einstellung ist, dass die Backup-Daten einer VM immer auf dem gleichen Speicher abgelegt werden und somit entweder komplett zur Verfügung stehen oder gar nicht, sollte der Backup-Speicher mal nicht zur Verfügung stehen. Bei der „Performance“-Einstellung werden die Daten der Backup-Kette immer auf dem Repository gespeichert, welches gerade frei ist und zur Verfügung steht. Sollte ein Backup-Speicher mal nicht zur Verfügung stehen, kann es sein, dass ein Teil der Backup-Daten nicht zur Verfügung steht und somit eine Wiederherstellung nicht funktioniert.

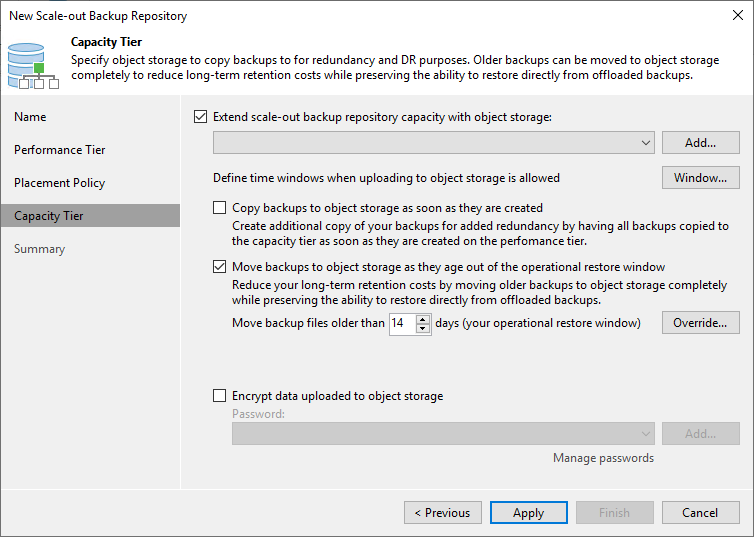

Unter „Capacity Tier“ können wir nun den nachgelagerten Speicher auswählen, auf den die Daten nach einem definierten Zeitraum verschoben werden.

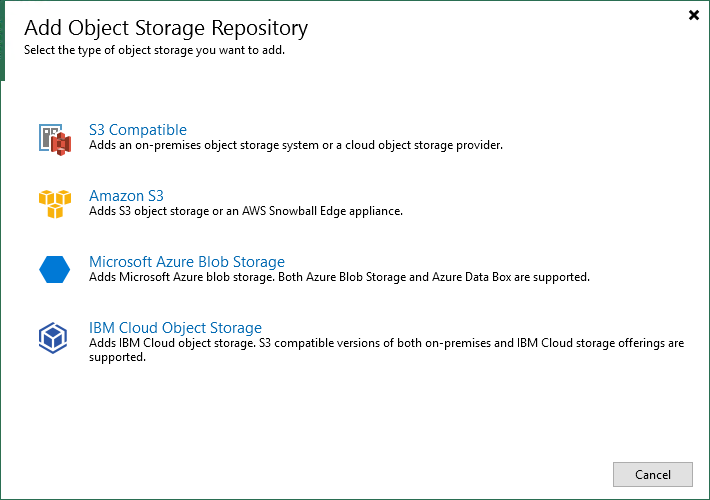

Wählen wir diese Option aus, müssen wir einen Objektspeicher angeben. Ist noch keiner vorhanden, können wir diesen über „Add“ hinzufügen. Ein Klick auf diese Option zeigt die verfügbaren Speicherarten.

Wir sehen hier, dass ein klassischer Speicher, wie z.B. unser StorHost2 mit vielen Festplatten, nicht unterstützt wird.

Ich nutze diese Funktion bei einigen Kunden und auch bei mir selbst, um die Daten zu einem Azure Blob Storage zu schieben. Die Kosten dafür halten sich, je nach Dauer der Aufbewahrung und Größe der Backups, im Rahmen und es muss kein eigener Objektspeicher angelegt werden. Ist dies nicht möglich oder nicht gewünscht, kann bei Bedarf auch eigener Objektspeicher hinzugefügt werden. Es gibt mehrere Hersteller von Storage-Systemen am Markt, die einen S3-kompatiblen Speicher anbieten und der an dieser Stelle genutzt werden könnte.

Unterschiede und Abhängigkeiten

Wie wir in den beiden vorherigen Kapiteln gesehen haben, haben beide Arten der Einrichtung Abhängigkeiten an die genutzte Hardware. Server mit internen Datenträgern sowie NAS- und SAN-Speicher können nicht als „Capacity Tier“ in ein Scale-Out Repository aufgenommen werden. Wird diese Art von Speicher genutzt, muss ein herkömmlicher Backup-Copy-Job verwendet werden. Wichtig ist hierbei, dass es grundsätzlich kein Nachteil ist, die Backup-Copy-Job Variante zu nutzen, es ist lediglich eine andere Art der Einrichtung.

Haben Sie hingegen die Möglichkeit, mit einem Scale-Out Repository zu arbeiten, ermöglicht dies Ihnen die Nutzung von einem Objektspeicher. Dies kann unter anderem dafür sorgen, dass Daten in diesem Speicher nicht mutwillig oder zufällig gelöscht werden kann, da jedes Objekt einen Schreibschutz besitzt und somit nicht durch Ransomware oder menschliche Fehler überschrieben werden kann.

Beachten Sie unbedingt, dass ein Scale-Out Repository mindestens die Enterprise Edition von Veeam voraussetzt. Hier können maximal zwei normale Repository hinzugefügt werden, erst in der Enterprise Plus Edition können Sie beliebig viel Speicher hinzufügen und nutzen.

Fazit

Mit Hilfe von Veeam und unterschiedlichen Typen von Backup-Speicher lassen sich viele Vorteile der jeweiligen Speichertypen miteinander kombinieren. Schneller Speicher in Form von SSDs oder NVMes sorgen für einen unglaublichen Performance-Schub bei einer Wiederherstellung und erhöht signifikant die Menge an VMs, die bei einer Wiederherstellung von Daten per „Instant Recovery“ aus dem Backup heraus gebootet werden können. Günstiger, aber deutlich langsamerer Speicher in Form von Festplatten sorgen für ausreichend Platz bei einem entsprechend geringen Preis pro GB, so dass Ihre Daten immer noch über mehrere Monate oder Jahre hinweg gespeichert werden können.

In Kombination mit Objektspeicher lässt sich der Transfer von Daten zu einem Cloud Anbieter vereinfachen und automatisieren, alternativ kann im eigenen Unternehmen ein S3 kompatibler Speicher aufgebaut werden, um Daten effektiv vor Ransomware oder unbefugtem Zugriff zu schützen.

Durch den Aufbau von einem Site-to-Site VPN zwischen Ihren Umgebung und dem Contabo Rechenzentrum haben Sie hier jederzeit die Möglichkeit, auf Ihre Daten zuzugreifen und mittels Backup-Kopie auf Ihren Speicher zu duplizieren. So besitzen Sie jederzeit eine Kopie der Daten. Alternativ können Sie die Daten auch in ein anderes RZ spiegeln, um eine geo-redundante Spiegelung zu haben.

Eine umfassende und saubere Planung im Vorfeld ermöglicht es Ihnen, dass Beste aus Ihrer Umgebung herauszuholen, die Backup-Zeiten zu minimieren und die Belastung im Tagesgeschäft möglichst gering zu halten.